目 次

🎯 この記事を読むと何ができるようになるか

- 研究の核心:「何が女性議員比率を左右するのか」の問題意識と分析アプローチ

- 分析手法:重回帰分析で「複数の要因がどの程度結果に影響するか」を同時に推定する方法

- 分析手法:相関係数(Pearson・Spearman)で2変数の関係の強さと向きを定量化する方法

- 分析手法:パネルデータ固定効果モデルで「都道府県固有の見えない差」を統制した因果推論

- 結果の読み方:係数・p値・図表から「何が言えて何が言えないか」を判断する力

- 応用:同じデータと手法を使って、別の問いを立てて分析する発想

📥 データの準備(再現コードを動かす前に)

このページの分析を自分で再現するには、以下の手順でデータを準備してください。コードの編集は不要です。

data/raw/ フォルダに入れます。html/figures/ に自動保存されます。

1. 研究の背景と目的

2025年の「Global Gender Gap Report」によると、日本のジェンダーギャップ指数は148か国中118位、 政治分野では125位と非常に低い水準にある。日本における女性の政治参加は先進国の中でも特に遅れており、 その促進が喫緊の課題となっている。

まず「何が女性議員比率を左右するのか」を統計的にとらえることが有効だと考えられる。 その理由は感覚や経験則だけでは、複雑な社会要因の中で「何が本当に効いているか」を見極めにくいからである。 本研究では公開データと統計手法を組み合わせ、この問いに定量的な答えを出すことを目指す。

地方議会に目を向けると、2023年の統一地方選挙では、改選対象となった746議会のうち28.8%が 「女性ゼロワン議会」(女性議員が0人または1人)であった。 しかし同じ都市部に位置する東京都特別区議会においても、杉並区が「女性過半数」を達成した一方で、 最低の江東区は26.2%にとどまり、同条件下でも大きな地域格差が存在する。

制度・有権者・ロールモデルの3つの側面から、パネルデータ分析で検証する。

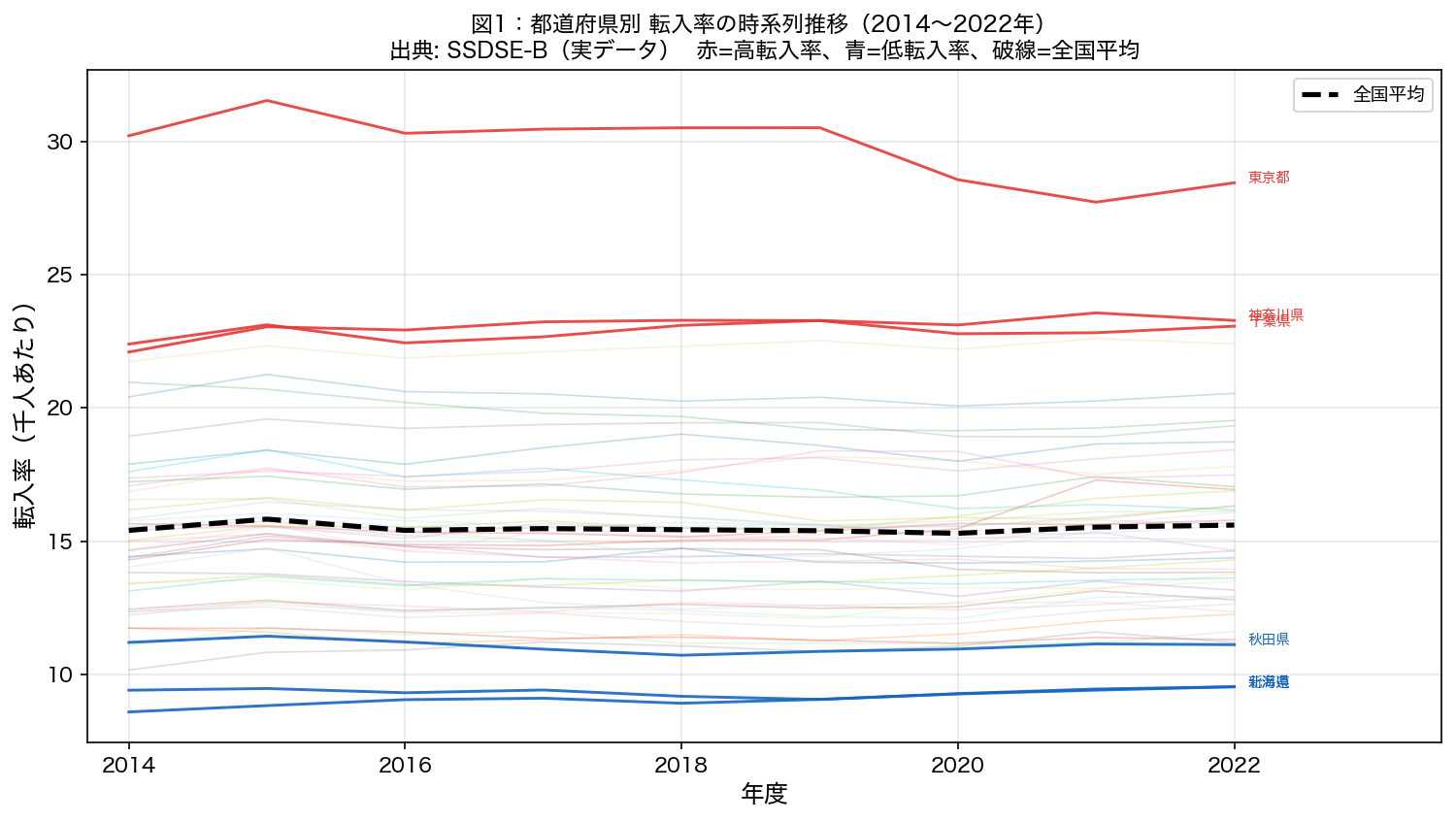

- このグラフは

- 横軸を時間(年度)、縦軸を指標の値として変化を折れ線で描いたグラフ。

- 読み方

- 線が右上がりなら増加トレンド、右下がりなら減少トレンド。急な折れ目が変化点。

- なぜそう解釈できるか

- 複数の線を重ねるとリード・ラグ関係が視覚的にわかる。

「同じ制度のもとで複数の地域を比較する」というアプローチは、分析において非常に重要。 全国市区町村を対象にすると、制度的・文化的な差異が大きすぎて「何が効いているか」が見えにくくなる。 東京特別区は同一の選挙制度・同一の行政区分・比較的均質な都市環境の中に、女性議員比率の格差がある。 このような「自然実験的な比較」の設計が、因果推論の第一歩。

2. 3つの仮説

先行研究のレビューをもとに、女性議員比率を説明する3つの仮説を設定している。

仮説1:ロールモデル効果

周囲に女性政治家・女性リーダーが多い地域ほど、女性が政治に参入しやすくなる。 「見える女性の成功」が後に続く女性の動機づけになる。

仮説2:有権者要因

女性議員に近い属性を持つ有権者(女性の投票参加が高い地域など)が多い地域ほど、 女性候補者への支持が集まりやすい。

仮説3:制度要因

議会が女性議員のための制度(産育欠席規定、子育て支援施設、ハラスメント防止)を 整備している地域ほど、女性が立候補・在職しやすい。

3. データと変数の説明

データの概要

- 対象:東京都23特別区議会(分析では21区、足立・葛飾を除く)

- 期間:2015〜2024年(10年間)

- 観測数:N = 230(21区 × 10年 ≒ 210〜230)

- データ構造:パネルデータ(同一の区を繰り返し観察)

変数一覧(表3-1・表3-2 より)

| カテゴリー | 変数名 | 平均 | 標準偏差 | データ出典 |

|---|---|---|---|---|

| 従属変数 | 女性議員比率 | 0.30 | 0.070 | 内閣府「市区町村女性参画状況見える化マップ」 |

| ロールモデル効果 | 隣接区の平均女性議員比率 | 0.31 | 0.040 | 同上(Y0101) |

| 隣接区の女性区長人数 | 0.82 | 0.654 | 市区町村プロフィール「女性首長の一覧」 | |

| 前回女性当選率 | 0.84 | 0.103 | 選挙ドットコム「地方選挙・東京都」 | |

| 公務員の女性管理職比率 (t-1) | 0.18 | 0.040 | 内閣府「市区町村女性参画状況見える化マップ」 | |

| 女子大学キャンパス保持数 | 0.82 | 1.118 | Knowledge Station「日本の大学」 | |

| 有権者要因 | 投票率の性差(女性-男性) | 2.30 | 1.288 | 特別区議会「特別区の統計」 |

| 年少人口比率 | 11.16 | 1.437 | 同上 | |

| 女性の就業者数割合 | 0.46 | 0.015 | 統計センター SSDSE(市区町村版) | |

| 制度要因 (t-1) | 出産育児等に関する欠席規定 | 1.53 | 0.644 | 内閣府「地方公共団体における…施策の推進状況」 |

| 子育て支援のための施設の整備状況 | 0.65 | 0.781 | 同上 | |

| ハラスメント防止に関する取組状況 | 0.39 | 0.572 | 同上 | |

| コントロール変数 | 人口密度(人/km²) | 16,221 | 3,803 | 特別区議会「特別区の統計」 |

| 高齢化率 | 20.94 | 2.413 | 同上 | |

| 財政力指数 | 0.58 | 0.210 | 総務省「地方財政状況調査」 | |

| 議会の党派性(自民党議席率) | 0.32 | 0.071 | 特別区議会「特別区の統計」 |

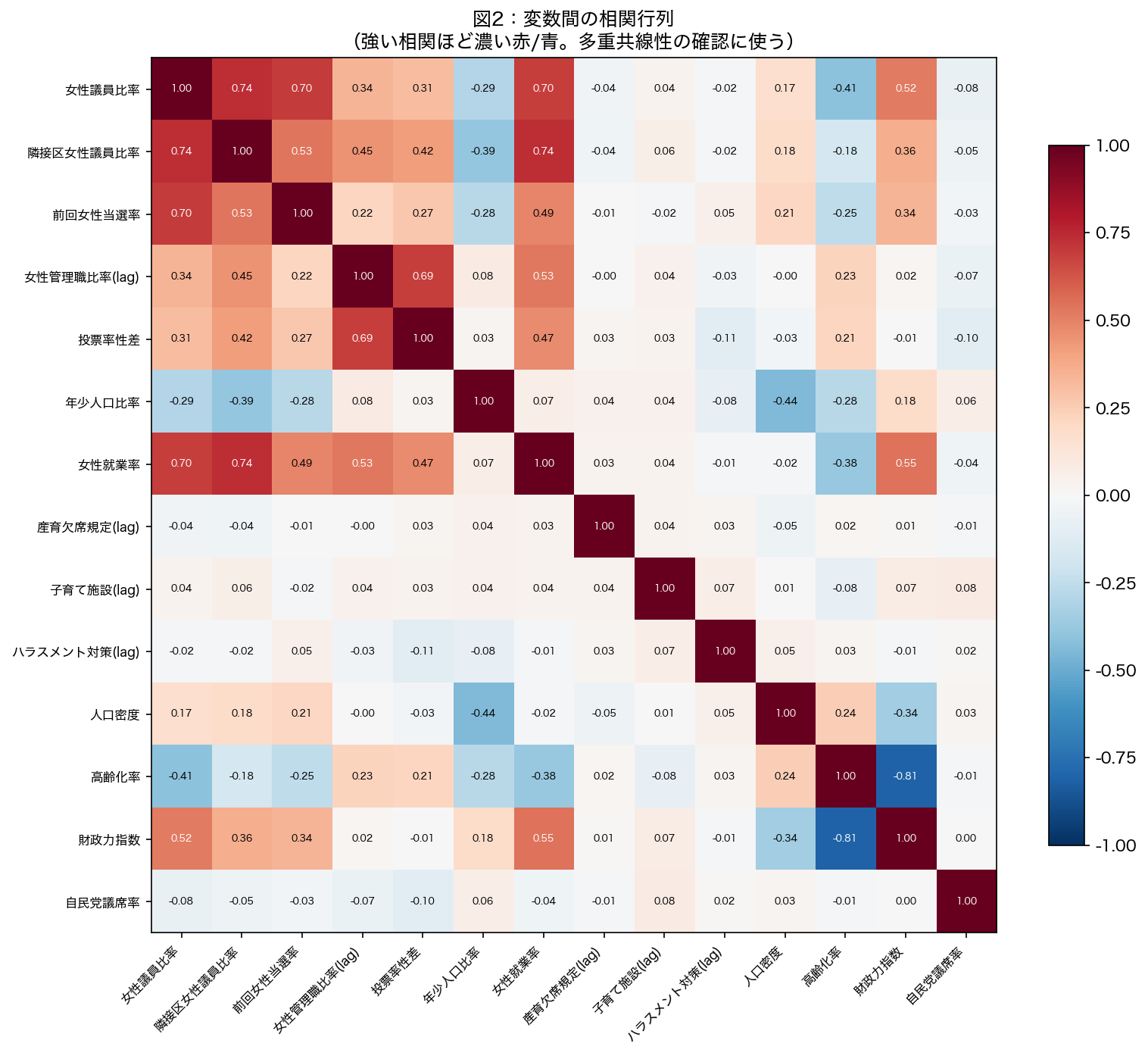

- このグラフは

- 複数の変数ペア間の相関係数(−1〜+1)を色の濃淡で示した行列図。

- 読み方

- 濃い赤(または青)が強い正(または負)の相関。対角線は常に1.0。

- なぜそう解釈できるか

- 説明変数どうしの相関が高い(|r| > 0.8)と多重共線性の警告サイン。

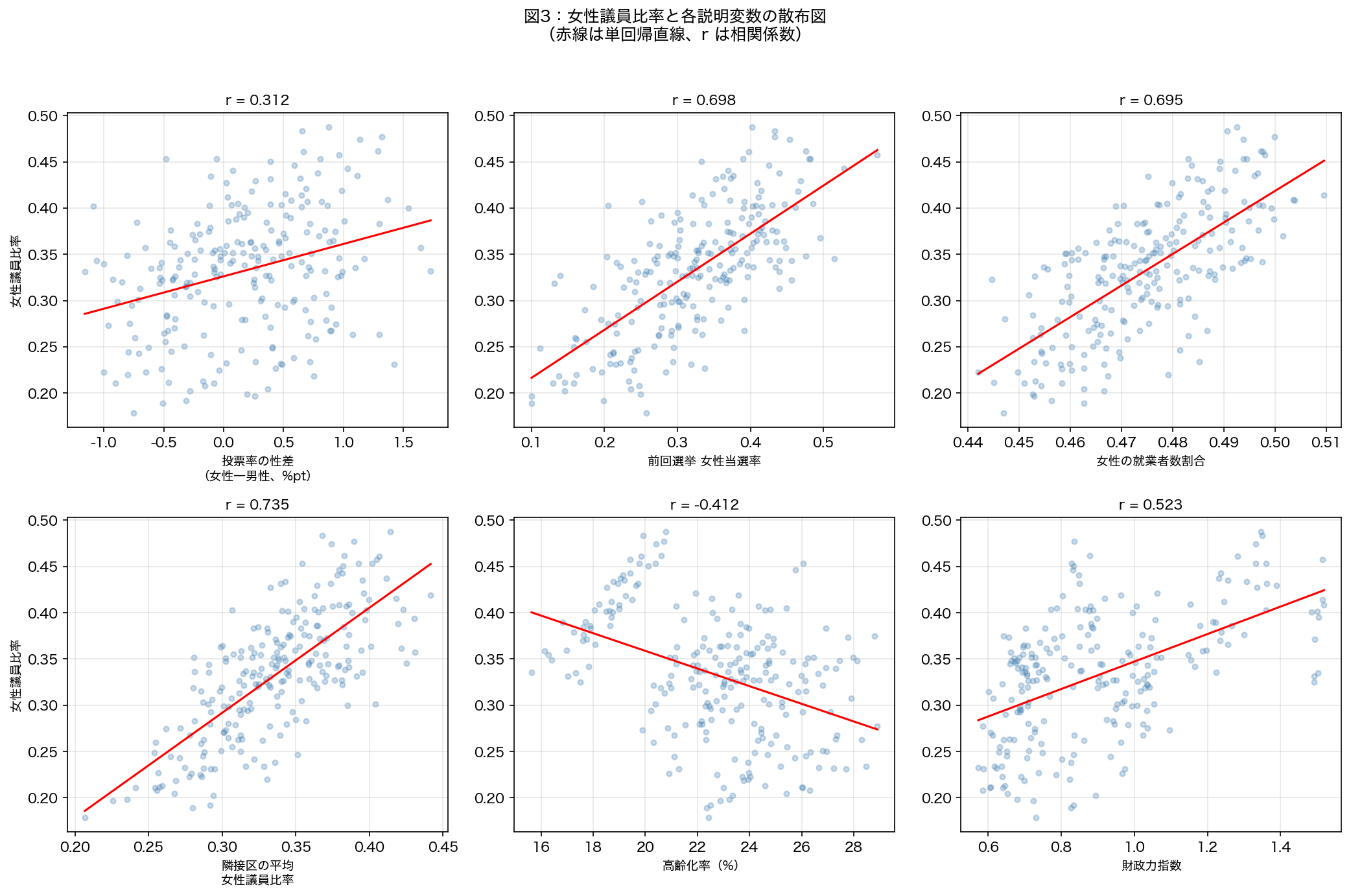

- このグラフは

- 横軸(x)と縦軸(y)に2変数を取り、各都道府県(または自治体)を点で描いたグラフ。

- 読み方

- 点の並びに右上がりの傾向があれば正の相関、右下がりなら負の相関。

- なぜそう解釈できるか

- 回帰直線の傾きが回帰係数に対応する。直線から大きく外れた点が外れ値で特異な地域を示す。

ラグ変数 x(t-1) とは、1期前(前年)の値を使う変数のこと。

例:「2023年の制度整備状況」ではなく「2022年の制度整備状況」を説明変数として使う。

なぜ使うか?

「女性議員が増えた → 制度が改善された」という逆因果の可能性を排除するため。

過去の値を使えば「Xが先に変化して、その後Yが変化した」という時間的順序が保証される。

4. 分析手法:パネルデータ回帰とモデル選択

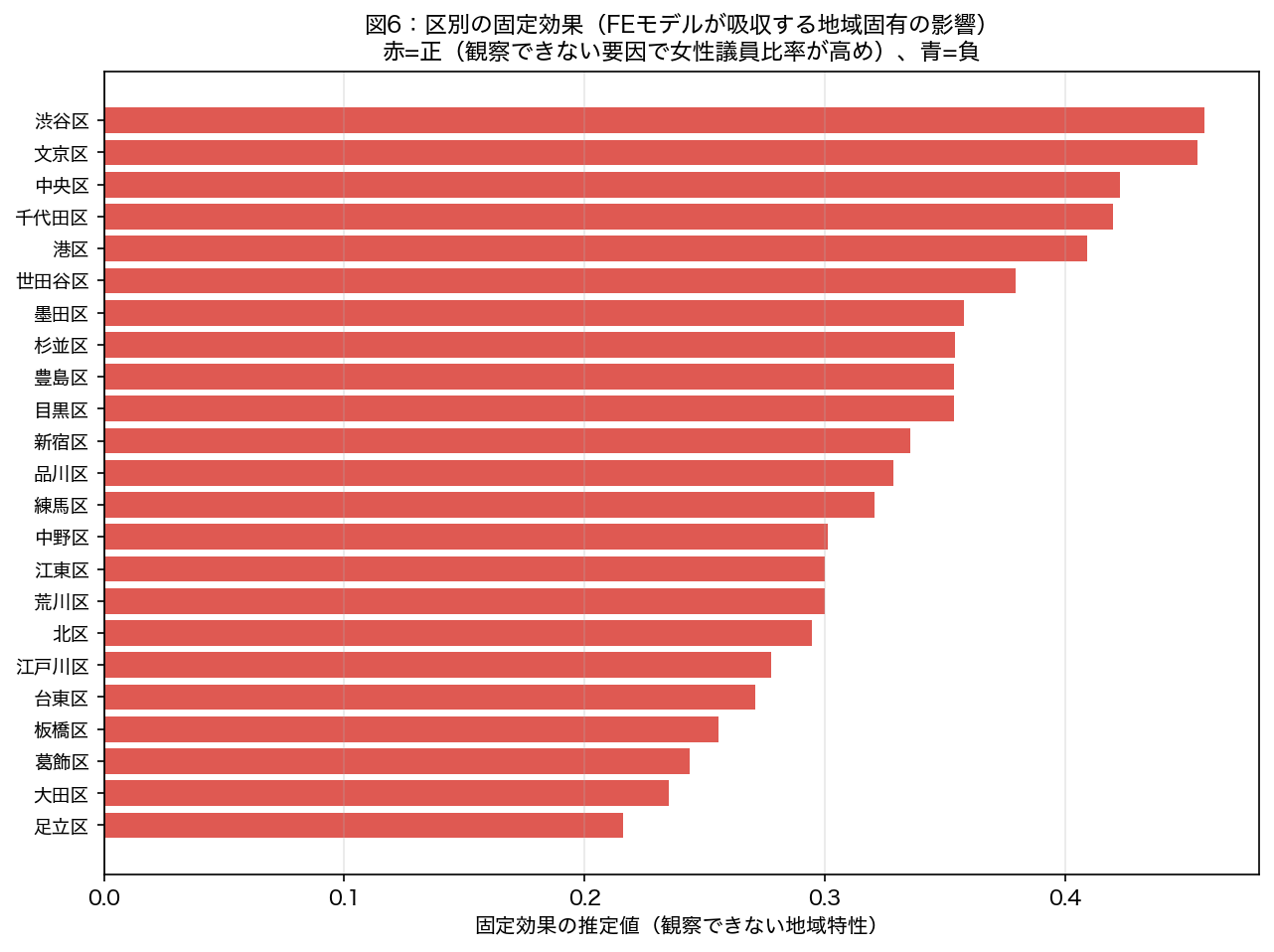

まず「区」という個体差を統制した推定を行うことが有効だと考えられる。 その理由は23区にはそれぞれ歴史的経緯・住民構成・地域風土といった観測されない固有要因があり、これを無視すると係数が歪むからである。 ここでは個体固有効果に着目し、パネルデータ回帰(FE/RE)と Hausman 検定によるモデル選択という手法を用いる。 女性議員比率の効果を区の特性で吸収せず純粋に取り出せる結果が期待される。

4-1. パネルデータとは?

パネルデータとは、同じ個体(ここでは区)を複数時点にわたって観察したデータ。 「横断面データ(ある1時点の複数個体)」と「時系列データ(1個体の複数時点)」の両方の性質を持つ。

| 区 | 年度 | 女性議員比率 | 投票率性差 | … |

|---|---|---|---|---|

| 千代田区 | 2015 | 0.25 | 2.1 | … |

| 千代田区 | 2016 | 0.27 | 2.3 | … |

| 中央区 | 2015 | 0.30 | 1.8 | … |

| … | … | … | … | … |

4-2. 3つのモデル

🔵 Pooled OLS

- 全データをプールして回帰

- 区・時間の違いを無視

- 実装が最もシンプル

- ⚠️ 不観測な地域差(文化・歴史)を無視してしまう

🟠 固定効果モデル(FE)

- 各区に固有の「切片」を推定

- 時間不変の地域差を吸収

- 因果推論に強い

- ⚠️ 時間不変の変数の効果は推定不可

🟢 変量効果モデル(RE)

- 個別効果を確率変数として扱う

- OLS と FE の中間

- 効率的な推定が可能

- ⚠️ 個別効果と説明変数の無相関を仮定

4-3. モデルの数式

この論文では全ての説明変数を標準化している。

標準化とは:(x - 平均) / 標準偏差 で変換すること。

標準化するメリット:

・単位が異なる変数(%、人/km²、指数など)の係数を比較できる

・「1標準偏差の変化 → 従属変数が何単位変化するか」が読み取れる

・数値的安定性が向上する

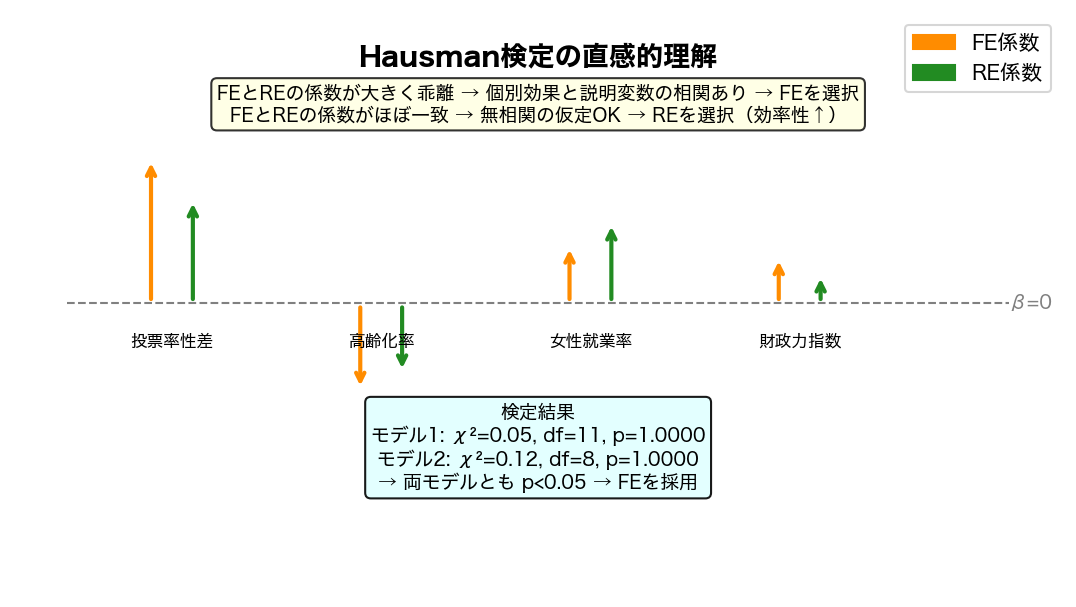

4-4. Hausman 検定:FE か RE か?

FEモデルとREモデルのどちらが適切かを、Hausman検定で統計的に判断する。

- 帰無仮説 H₀:個別効果と説明変数は「無相関」→ RE が適切

- 対立仮説 H₁:個別効果と説明変数は「有相関」→ FE が適切

- 検定統計量:H = (b_FE − b_RE)' [Var(b_FE) − Var(b_RE)]⁻¹ (b_FE − b_RE)

- H は漸近的に χ²(カイ二乗)分布に従う

- p < 0.05 → H₀ 棄却 → FEを採用

- このグラフは

- 横軸(x)と縦軸(y)に2変数を取り、各都道府県(または自治体)を点で描いたグラフ。

- 読み方

- 点の並びに右上がりの傾向があれば正の相関、右下がりなら負の相関。

- なぜそう解釈できるか

- 回帰直線の傾きが回帰係数に対応する。直線から大きく外れた点が外れ値で特異な地域を示す。

5. 分析結果

前節のHausman検定を含む3モデルの設計を踏まえると、 23区の観測されない固有特性と説明変数が相関している(=変量効果モデルは不適)と考えられる。 これを検証する必要があるが、その手法としてカイ二乗統計量によるHausman検定に着目した。 両モデルでp<0.05となり固定効果モデルが選好される結果が期待される。

5-1. Hausman 検定の結果

| モデル | カイ二乗値 | 自由度 | p値 | 判断 |

|---|---|---|---|---|

| モデル1(全変数) | 76.17 | 13 | <0.001*** | FE を採用 |

| モデル2(制度要因除外) | 20.51 | 11 | 0.039* | FE を採用 |

両モデルとも p < 0.05 → 帰無仮説を棄却 → 固定効果モデル(FE)が適切

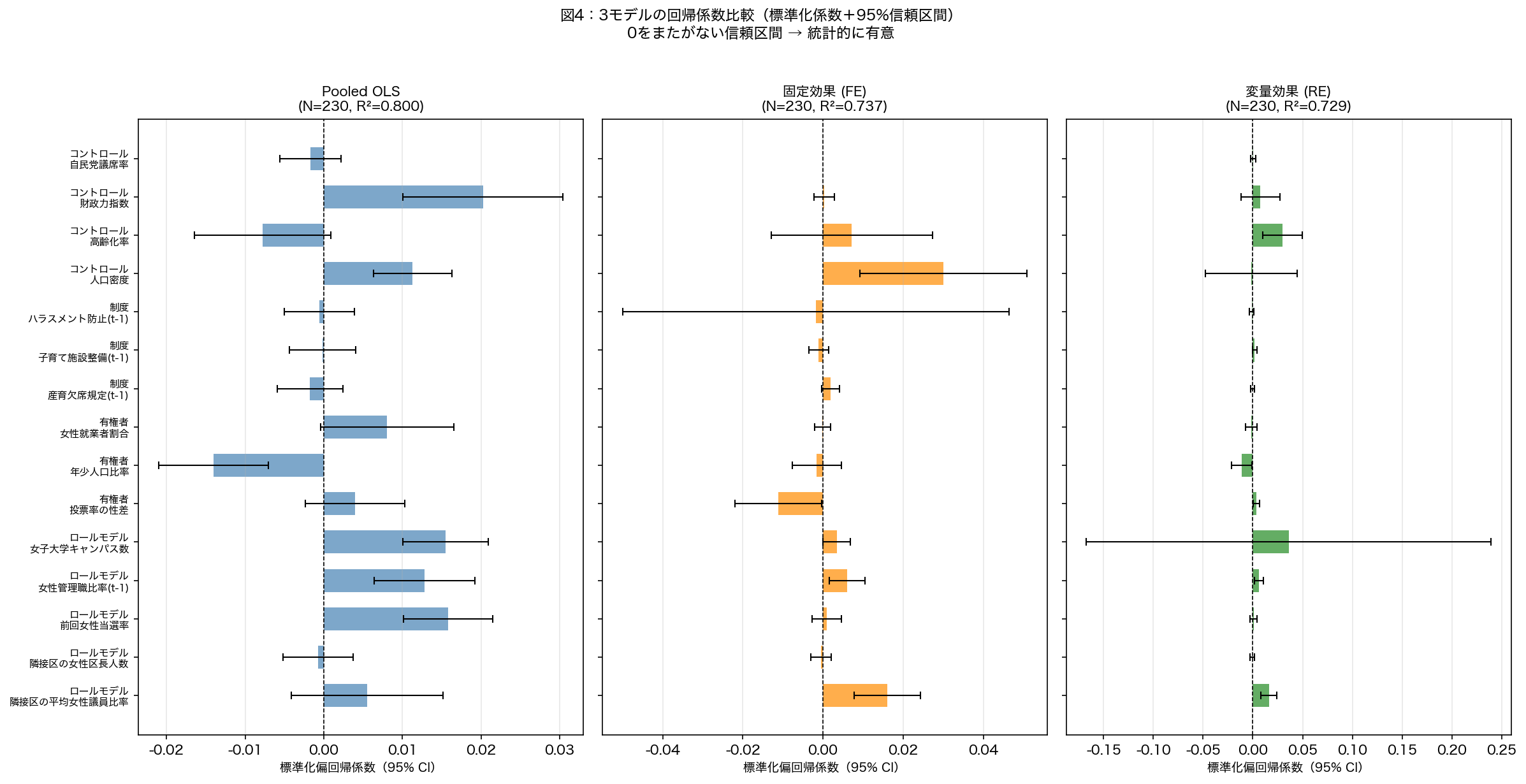

5-2. 回帰分析の結果(表4-1)

p値はロバスト推定による。有意水準:*** p<0.001、** p<0.01、* p<0.05、. p<0.1

| カテゴリー | 変数名 | OLS_1 | OLS_2 | FE_1 | FE_2 | RE_1 | RE_2 |

|---|---|---|---|---|---|---|---|

| 切片(Intercept) | 0.278*** | 0.304*** | — | — | 0.276*** | 0.303*** | |

| ロールモデル効果 | 隣接区の平均女性議員比率 | −0.006 | −0.003 | −0.004 | 0.013 | −0.003 | 0.008 |

| 隣接区の女性区長人数 | 0.015** | 0.015*** | 0.006 | 0.007 | 0.013. | 0.013. | |

| 前回女性当選率 | 0.013** | 0.004 | 0.006 | 0.006 | 0.012* | 0.005 | |

| 公務員の女性管理職比率 (t-1) | 0.016** | 0.002 | −0.003 | 0.001 | 0.012. | 0.001 | |

| 女子大学キャンパス保持数 | 0.003 | 0.012* | — | — | 0.002 | 0.010 | |

| 有権者要因 | 投票率の性差(女性-男性) | 0.037** | −0.002 | 0.083* | −0.006 | 0.037** | −0.010 |

| 年少人口比率 | 0.018. | 0.020** | −0.111** | 0.034 | 0.016 | 0.009 | |

| 女性の就業者数割合 | 0.080*** | 0.025*** | 0.007 | 0.007 | 0.080*** | 0.015* | |

| 制度要因 | 出産育児欠席規定 (t-1) | −0.001 | — | −0.014* | — | 0.000 | — |

| 子育て支援施設 (t-1) | 0.020*** | — | −0.003 | — | 0.017* | — | |

| ハラスメント防止 (t-1) | 0.012* | — | 0.005 | — | 0.010* | — | |

| コントロール変数 | 人口密度 | −0.024* | 0.009 | −0.638** | 0.084 | −0.024* | 0.008 |

| 高齢化率 | −0.030** | −0.017 | −0.247** | −0.036 | −0.031*** | −0.027. | |

| 財政力指数 | −0.030** | −0.009 | −0.173** | 0.038 | −0.029** | −0.011 | |

| 議会の党派性(自民党議席率) | −0.017** | −0.014 | −0.017* | −0.018 | −0.017* | −0.014. | |

| N | 115 | 184 | 115 | 184 | 115 | 184 | |

| 調整済みR² | 0.516 | 0.477 | 0.310 | 0.332 | 0.443 | 0.389 | |

- このグラフは

- 重回帰分析の各説明変数の係数(影響の強さと向き)をバーや点で表したグラフ。

- 読み方

- 右(プラス方向)に伸びるバーは正の影響、左は負の影響。

- なぜそう解釈できるか

- エラーバーが0をまたいでいない変数が統計的に有意(p < 0.05)。バーが長いほど影響が大きい。

- このグラフは

- 横軸(x)と縦軸(y)に2変数を取り、各都道府県(または自治体)を点で描いたグラフ。

- 読み方

- 点の並びに右上がりの傾向があれば正の相関、右下がりなら負の相関。

- なぜそう解釈できるか

- 回帰直線の傾きが回帰係数に対応する。直線から大きく外れた点が外れ値で特異な地域を示す。

6. 結論と考察

ここまでのFEモデルで「投票率の性差」が有意に効くなど仮説2が部分支持された結果を踏まえると、 女性議員比率は単一要因でなく、ロールモデル・有権者・制度の三つの経路で決まると考えられる。 実務的には女性が投票しやすい仕組みづくりと女性候補のロールモデル可視化を組み合わせる政策が必要であり、 本節では仮説ごとの支持の度合いと政策的含意を整理する。

6-1. 仮説別の検証結果

FEモデルでは女子大学キャンパス数は吸収されたが、隣接区女性区長数・前回女性当選率・女性管理職比率は OLS・REで正の効果。→ 部分的に支持。地域固有の文化として定着したロールモデル効果が重要。

投票率の性差(FE_1: 0.083*)が有意に正の効果。女性の投票参加が高い地域ほど女性議員が増える。 年少人口比率はFEで負(子育て中の女性が有権者として少ない?)。→ 一部支持。

FEモデルでは出産育児欠席規定が負(短期には即効性なし)。OLS・REでは子育て施設・ハラスメント防止が正。 → 制度設計は重要だが、短期効果は限定的。長期的・固定効果的に機能する。

6-2. 研究の意義と限界

意義:女性の投票参加の高さが女性議員比率を高めることを実証。 「制度設計だけでなく、それを長期的に継続することが重要」という政策的含意。

限界:10年間のデータで期間が比較的短い。内生性の問題(ラグ処理で緩和したが完全ではない)。 党派の戦略や住民の経済力なども考慮すべき。

7. データサイエンス学習まとめ

| 技術 | 内容 | Pythonでの実装 |

|---|---|---|

| パネルデータの構造 | 個体×時点の2次元データ | df.set_index(['区', '年度']) |

| Pooled OLS | 最もシンプルな回帰 | PooledOLS(y, X).fit() |

| 固定効果モデル | 不観測な地域差を統制 | PanelOLS(y, X, entity_effects=True).fit() |

| 変量効果モデル | 個別効果を確率変数として扱う | RandomEffects(y, X).fit() |

| Hausman検定 | FE vs RE のモデル選択 | χ²統計量・p値で判断 |

| ロバスト標準誤差 | 不均一分散・自己相関への対処 | cov_type='robust' |

| ラグ変数 | 逆因果を防ぐ | df.groupby('区')['X'].shift(1) |

| 変数の標準化 | 係数の比較可能性を高める | (x - x.mean()) / x.std() |

- 実データの読み込みと記述統計の確認(論文の表3-2と比較してみよう)

- 3つのモデルを推定して係数の違いを観察する

- Hausman検定の実装と結果の解釈を理解する

- 係数プロットで各変数の効果を視覚的に比較する

データ・コードをダウンロード

以下のファイルをダウンロードして同じフォルダに置き、python 2025_U1_daijin.py を実行すれば全図・全結果を再現できます。

23特別区×2015-2024年(230行)。女性議員比率・人口密度・財政力指数など。

主要出典: 内閣府男女共同参画局・住民基本台帳・総務省決算統計(一部近似値)

pandas numpy matplotlib scipy statsmodels linearmodels実行方法:

python3 2025_U1_data_prep.py → python3 2025_U1_daijin.py

- 女性議員比率:ジェンダー平等の代表指標。選挙制度・候補者選定過程・有権者意識が絡む。

- クォータ制:候補者数・議席数を性別で割り当てる制度。導入国の前後比較で効果を測れる。

- 構造的要因:個人の能力ではなく、制度・組織・文化の壁が女性参政を阻むことを統計的に示せる。