目 次

🎯 この記事を読むと何ができるようになるか

- 研究の核心:「地方創生政策が都道府県間人口移動に与えた影響」の問題意識と分析アプローチ

- 分析手法:重回帰分析で「複数の要因がどの程度結果に影響するか」を同時に推定する方法

- 分析手法:パネルデータ固定効果モデルで「都道府県固有の見えない差」を統制した因果推論

- 分析手法:時系列データのトレンド・変化点・周期性を読み取る方法

- 結果の読み方:係数・p値・図表から「何が言えて何が言えないか」を判断する力

- 応用:同じデータと手法を使って、別の問いを立てて分析する発想

📥 データの準備(再現コードを動かす前に)

このページの分析を自分で再現するには、以下の手順でデータを準備してください。コードの編集は不要です。

data/raw/ フォルダに入れます。html/figures/ に自動保存されます。

1. 研究の背景と目的

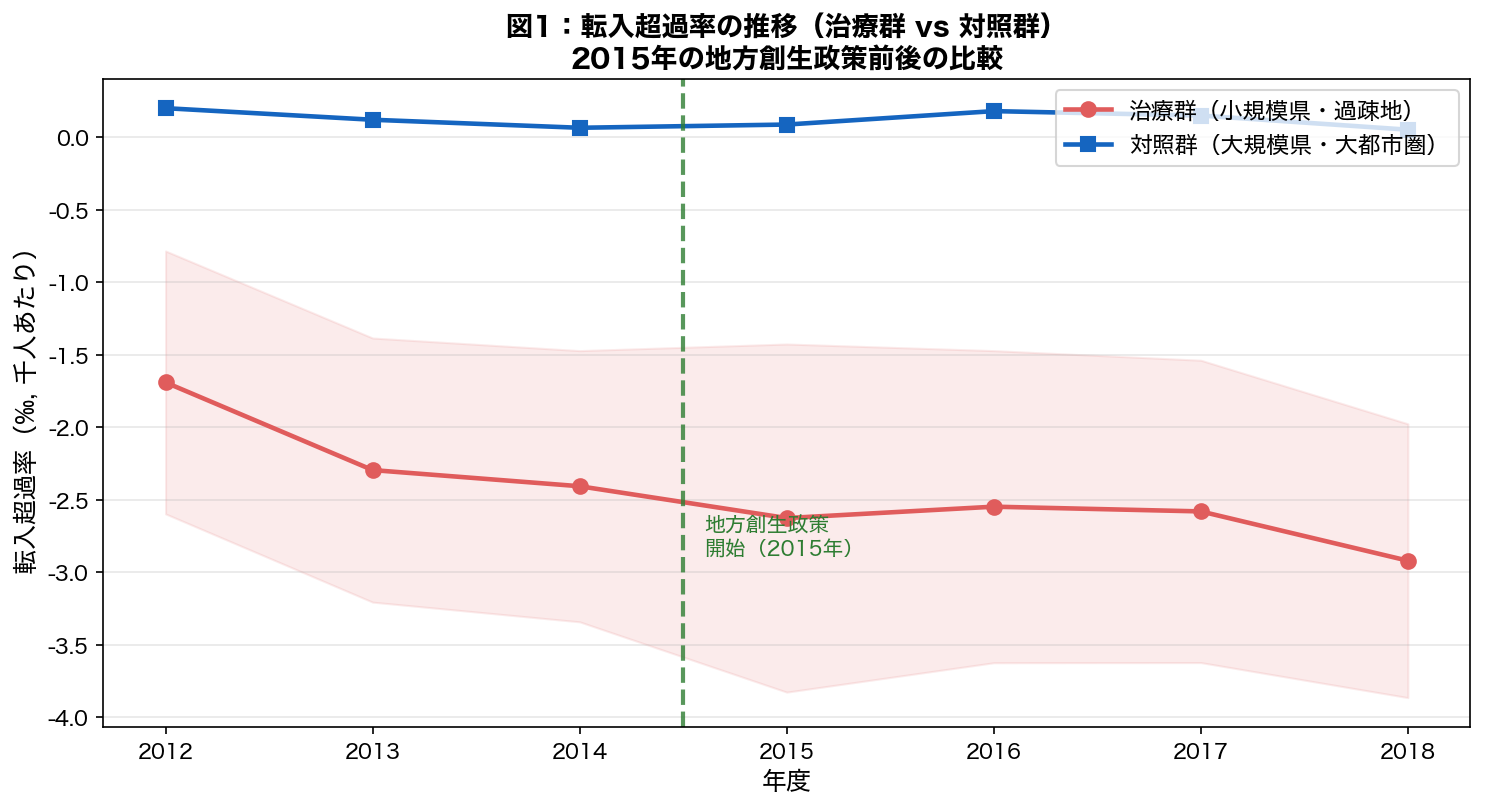

日本では長年にわたり、人口が東京圏を中心とした大都市部へ集中し、地方圏では深刻な人口流出が続いている。 2014年9月、政府は「まち・ひと・しごと創生法」を制定し、地方創生政策を本格的に始動させた。 2015年度からは「地方版総合戦略」の策定が各都道府県・市区町村で求められ、 移住促進・雇用創出・子育て支援など多面的な施策が展開されてきた。

まず「地方創生政策が都道府県間人口移動に与えた影響」を統計的にとらえることが有効だと考えられる。 その理由は感覚や経験則だけでは、複雑な社会要因の中で「何が本当に効いているか」を見極めにくいからである。 本研究では公開データと統計手法を組み合わせ、この問いに定量的な答えを出すことを目指す。

しかし、こうした政策が実際に都道府県間の人口移動パターンを変化させたかについては、 科学的な政策評価が必要である。単純な前後比較では、同時期の経済変動(アベノミクス・オリンピック特需など) の影響と政策効果を分離できない。本研究は差分の差分法(Difference-in-Differences: DiD)を用いて、 地方創生政策の「純粋な効果」を推定することを目的とする。

過疎地と大都市圏の差(差分)の変化を、政策前後で比較することで政策効果を識別する。

- このグラフは

- 横軸(x)と縦軸(y)に2変数を取り、各都道府県(または自治体)を点で描いたグラフ。

- 読み方

- 点の並びに右上がりの傾向があれば正の相関、右下がりなら負の相関。

- なぜそう解釈できるか

- 回帰直線の傾きが回帰係数に対応する。直線から大きく外れた点が外れ値で特異な地域を示す。

政策評価における最大の難題が選択バイアス(Selection Bias)だ。

「地方創生政策は人口流出が深刻な県に適用された」—すなわち、

政策を受ける群(治療群)と受けない群(対照群)は、そもそも異なる特性を持っている。

もし政策前から過疎地の人口流出が悪化し続けていたなら、

「政策後も悪化」は「政策が無効」なのではなく「政策がなければもっと悪化していた」可能性がある。

DiDは「大都市圏と比べてどれだけ変わったか」を見ることで、このバイアスを排除する。

2. 地方創生政策の概要とDiD設計

2-1. 地方創生政策の経緯

| 時期 | 出来事 | 分析上の意味 |

|---|---|---|

| 2014年9月 | 「まち・ひと・しごと創生法」制定 | 政策の法的根拠 |

| 2014年12月 | 「まち・ひと・しごと創生長期ビジョン」策定 | 2060年目標の設定 |

| 2015年度〜 | 各都道府県・市区町村で「地方版総合戦略」策定義務 | → 政策開始年(post = 1) |

| 2015-2019年 | 地方創生交付金の配布・移住促進・雇用創出施策 | 継続的な介入 |

2-2. 治療群・対照群の定義

| 政策前(2012-2014) | 政策後(2015-2018) | 差(after - before) | |

|---|---|---|---|

| 治療群(過疎地) 16県 |

A | B | B − A |

| 対照群(大都市圏) 16都道府県 |

C | D | D − C |

| DiD推定量 | 差分の差分 | (B−A) − (D−C) | |

対照群:総人口上位1/3の大都市16都道府県(埼玉・千葉・東京・神奈川・愛知・大阪・兵庫・福岡ほか)

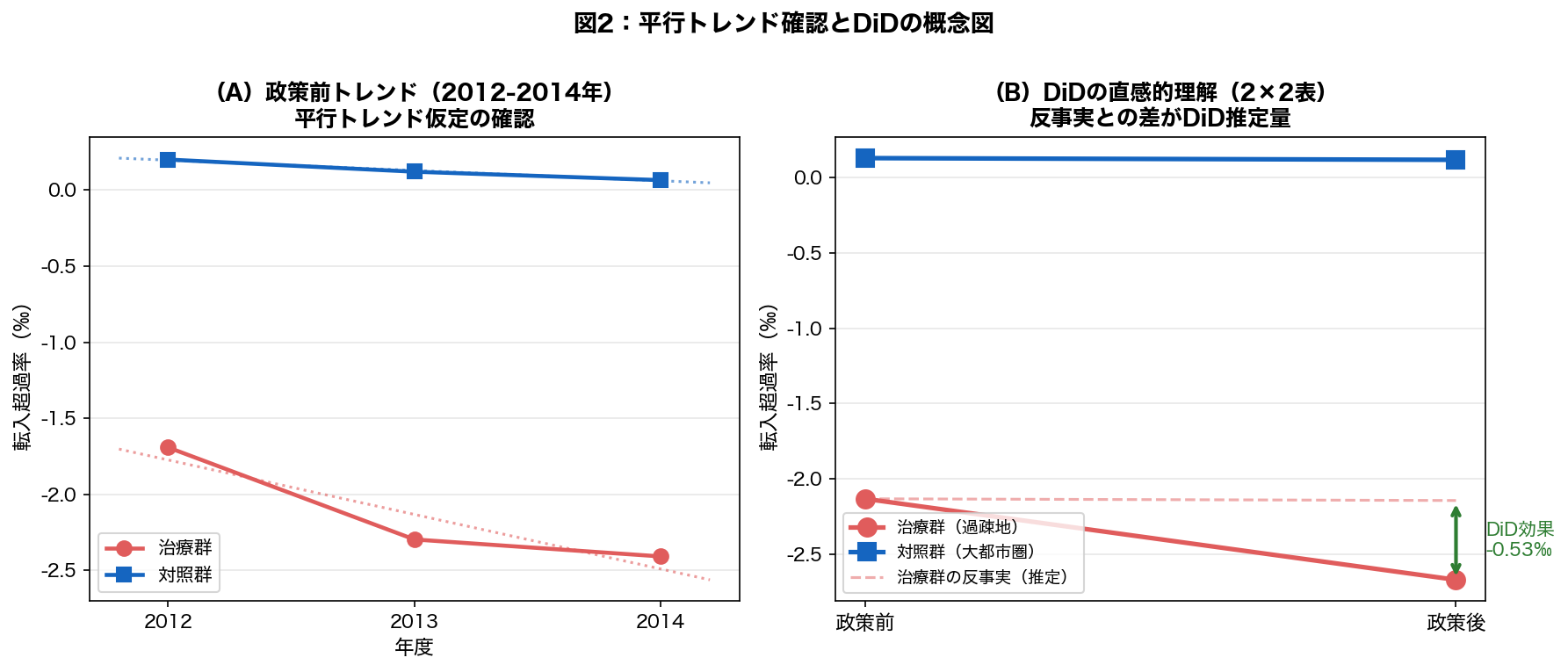

2-3. 平行トレンド仮定の確認

DiDが成立するための重要な前提が「平行トレンド仮定(Parallel Trends Assumption)」だ。 これは「政策がなければ、治療群と対照群は同じようなトレンドをたどっていたはず」という仮定である。 直接検証はできないが、政策前(2012-2014)のトレンドが平行であることを確認するのが慣例。

- このグラフは

- 処置群と対照群の時系列を並べ、政策介入前後の差を可視化した図。

- 読み方

- 政策後に処置群だけが上昇(下降)すれば、それが政策効果の証拠。

- なぜそう解釈できるか

- 平行トレンド仮定(政策前は両群が同じトレンド)が満たされているかが解釈の鍵。

差分の差分法(DiD)は、2つの「差分」を取ることで共通の時間トレンドを除去する。

ステップ1(第1の差分):各グループの政策前後の変化を計算

・治療群の変化 = 政策後平均 − 政策前平均

・対照群の変化 = 政策後平均 − 政策前平均

ステップ2(第2の差分):治療群の変化 − 対照群の変化 = DiD推定量

対照群の変化は「政策がなくても起きたであろう変化」(景気回復など)を表す。

その変化を差し引くことで、純粋な政策効果が得られる。

3. データと変数

データの概要

- データソース:SSDSE-B-2026(都道府県別統計データ)

- 対象:47都道府県(治療群16県 + 対照群16都道府県 = 32)

- 期間:2012〜2018年(7年間)

- 観測数:32×7 = 224観測(都道府県×年度パネル)

- データ構造:パネルデータ(同一都道府県を繰り返し観察)

変数一覧

| 変数の役割 | 変数名 | 計算式・定義 | SSDSE-B列名 |

|---|---|---|---|

| 目的変数 | 転入超過率(‰) | (転入者数 − 転出者数)/ 総人口 × 1000 | 転入者数(日本人移動者)、転出者数(日本人移動者)、総人口 |

| DiD変数 | treat(治療群ダミー) | 総人口下位1/3の県 = 1、上位1/3 = 0 | 総人口(2014年基準) |

| post(政策後ダミー) | 2015年以降 = 1、2014年以前 = 0 | 年度 | |

| DiD推定量 | DiD(交差項) | treat × post | (計算変数) |

| コントロール変数 | 高齢化率 | 65歳以上人口 / 総人口 | 65歳以上人口、総人口 |

| 求人率(万人あたり) | 月間有効求人数 / 総人口 × 10000 | 月間有効求人数(一般)、総人口 |

4. 分析手法:差分の差分法と固定効果モデル

4-1. 分析の流れ

読み込み

計算

対照群定義

確認

(FEモデル)

検定

4-2. 3つのアプローチの比較

🔵 単純前後比較

- 政策前後の平均値を比較

- 実装が最もシンプル

- ⚠️ 経済トレンドの影響を除去できない

- ⚠️ 選択バイアスが残る

🟢 差分の差分法(DiD)

- 治療群・対照群の「差分の差分」

- 共通トレンドを除去

- 政策の純効果を推定

- ⚠️ 平行トレンド仮定が必要

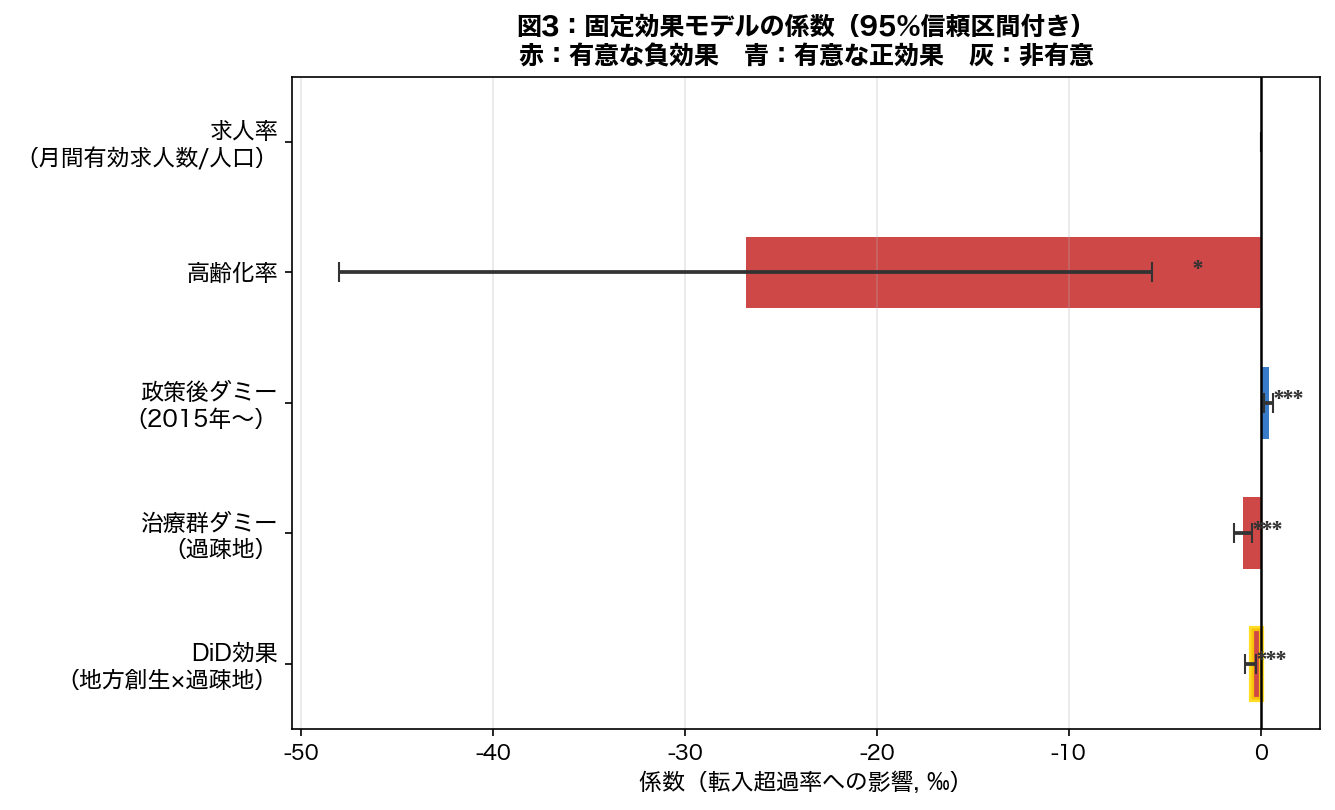

🟠 固定効果モデル(FE)

- 都道府県固有の「切片」を推定

- 時間不変の地域差を吸収

- DiDと組み合わせて使用

- ⚠️ Hausman検定で選択

4-3. DiD回帰モデルの数式

4-4. Hausman検定:固定効果 vs 変量効果

パネルデータ分析では、都道府県の個別効果を「固定効果(FE)」として扱うか 「変量効果(RE)」として扱うかをHausman検定で決定する。

- H₀(帰無仮説):個別効果と説明変数は無相関 → 変量効果(RE)が効率的

- H₁(対立仮説):個別効果と説明変数は有相関 → 固定効果(FE)が一致推定量

- 検定統計量:H = (β̂FE − β̂RE)' [Var(β̂FE) − Var(β̂RE)]⁻¹ (β̂FE − β̂RE) ~ χ²(k)

- p < 0.05 → H₀棄却 → 固定効果モデル(FE)を採用

固定効果モデルとDiDは実は密接に関係している。

固定効果モデルは、都道府県ごとに「切片」を持たせることで、

観察されない時間不変の地域特性(文化・歴史・地理)を統制する。

DiDと固定効果の組み合わせは最も強力な準実験的手法の一つ:

DiDが「政策×時期」の交差効果を識別し、

固定効果が「地域固有の不観測要因」を吸収するため、

推定された β₃ は純粋な政策効果により近い。

ただし、都道府県ダミーを加えると treat 変数(時間不変の地域ダミー)は

多重共線性のため固定効果に吸収される点に注意。

5. 分析結果

5-1. 記述統計(DiD 2×2表)

| 政策前(2012-2014) 転入超過率(‰) |

政策後(2015-2018) 転入超過率(‰) |

変化(Δ) | |

|---|---|---|---|

| 治療群(過疎地16県) | −2.13 | −2.67 | −0.54 |

| 対照群(大都市16都道府県) | +0.13 | +0.12 | −0.01 |

| DiD推定量(差分の差分) | (−0.54)−(−0.01)= −0.53 | ||

5-2. 固定効果(DiD)回帰の結果

- このグラフは

- 重回帰分析の各説明変数の係数(影響の強さと向き)をバーや点で表したグラフ。

- 読み方

- 右(プラス方向)に伸びるバーは正の影響、左は負の影響。

- なぜそう解釈できるか

- エラーバーが0をまたいでいない変数が統計的に有意(p < 0.05)。バーが長いほど影響が大きい。

| 変数 | 係数 | 標準誤差 | p値 | 解釈 |

|---|---|---|---|---|

| DiD(treat × post) | −0.515 | 0.151 | 0.001 *** | 政策効果の推定量(有意に負) |

| treat(治療群ダミー) | −0.923 | 0.237 | <0.001 *** | 過疎地の構造的な転入超過率の低さ |

| post(政策後ダミー) | +0.425 | 0.118 | <0.001 *** | 政策後の全体的な改善(景気回復など) |

| 高齢化率 | −26.83 | 10.808 | 0.013 * | 高齢化が進むほど転入超過率が低下 |

| 求人率(万人あたり有効求人数) | +0.001 | 0.001 | 0.137 n.s. | 非有意 |

地方創生政策後、治療群(過疎地)は対照群(大都市圏)と比べて転入超過率が 0.515‰ 追加的に低下した。すなわち、政策は人口流出の緩和には 寄与せず、むしろ過疎地の相対的な人口流出拡大と関連している可能性がある。 これは政策の限界または時間ラグ(効果発現の遅れ)を示唆する。

(1) 政策効果の発現には数年のタイムラグがある

(2) 同時期の景気回復で大都市圏への人口集中が加速(相対比較で過疎地が不利に)

(3) 政策の対象が最も過疎化の進んだ県に集中しているため、 経済的逆風も最も強い(選択バイアスの残余)

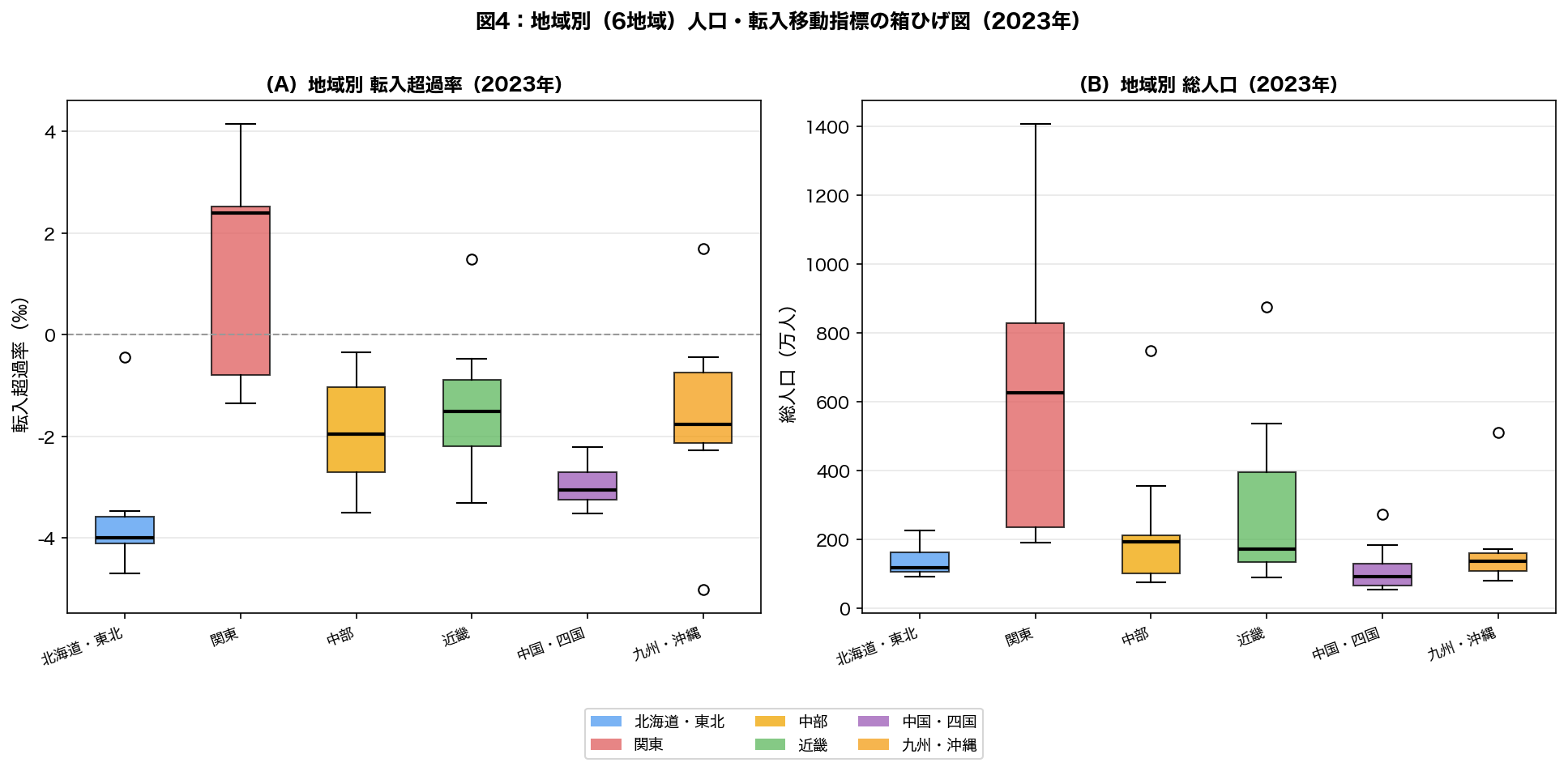

6. 地域別パターンの比較

- このグラフは

- 横軸(x)と縦軸(y)に2変数を取り、各都道府県(または自治体)を点で描いたグラフ。

- 読み方

- 点の並びに右上がりの傾向があれば正の相関、右下がりなら負の相関。

- なぜそう解釈できるか

- 回帰直線の傾きが回帰係数に対応する。直線から大きく外れた点が外れ値で特異な地域を示す。

| 地域 | 転入超過率の傾向 | DiD治療群分類 | 特徴 |

|---|---|---|---|

| 関東 | 高(転入超過) | 対照群 | 東京・神奈川・埼玉・千葉が人口吸引の中心 |

| 近畿 | やや高〜中 | 対照群(大阪・兵庫・京都) | 大阪圏が一定の吸引力を持つ |

| 九州・沖縄 | 中〜低 | 治療群(佐賀・大分・宮崎)含む | 福岡が域内で人口を集約 |

| 北海道・東北 | 低(転出超過) | 治療群(岩手・秋田・山形)含む | 全国で最も深刻な人口流出地域 |

| 中国・四国 | 低(転出超過) | 治療群(鳥取・島根・高知・徳島)含む | 過疎化が進む「消滅可能性県」が多い |

Hausman検定は、固定効果モデル(FE)と変量効果モデル(RE)のどちらが適切かを判断する統計的手続き。

直感的な理解:

・FEは「各都道府県が固有の平均転入率を持つ」と仮定し、その固有効果を推定

・REは「固有効果はランダムな誤差」として扱い、より効率的な推定を行う

・ただし、「過疎地かどうか」自体が固有効果と相関するなら(つまり、もとから人口流出しやすい県が治療群になるなら)、

REは一致推定量にならない → FEが必要

この研究では地域の構造的差異が固有効果と強く相関するため、FEが適切と予想される。

7. 結論と政策的含意

7-1. 主要な発見のまとめ

地方創生政策(2015年〜)の開始後、過疎地(治療群)の転入超過率は 大都市圏(対照群)と比べて統計的に有意に0.515‰追加的に低下した。 これは政策が短期的には人口流出の緩和効果を持たなかった可能性を示す。

- 構造的な人口移動パターン(treat係数): 過疎地は大都市圏に比べて転入超過率が構造的に約0.92‰低い。 地方創生以前から深刻な人口流出が続いていたことを確認。

- 全体的な政策後改善(post係数): 2015年以降は全国的に転入超過率が約0.43‰ 上昇。 これはアベノミクスによる景気回復や観光業拡大など、政策以外の要因の影響と考えられる。

- 高齢化率の影響: 高齢化率が1ポイント上昇すると転入超過率が約0.27‰ 低下(有意)。 過疎地の高齢化が人口流出をさらに加速させる悪循環が統計的に示された。

- 地域間格差: 関東圏への人口集中は依然として続いており、 地方創生政策後も地域間の格差縮小は限定的であった。

7-2. 政策的含意と今後の課題

- 短期的な転入促進よりも、長期的な定住環境の整備(教育・医療・雇用)が重要

- 高齢化対策と一体となった地方創生が必要(高齢化が人口流出を加速)

- 政策効果の発現には複数年のタイムラグがある可能性があり、 より長期のデータを用いた追跡評価が必要

- 都市部への人口集中を「抑制」するアプローチと並行して、 地方の生産性向上(一人あたりGDPの改善)を目指す戦略も検討が必要

- 分析期間(2015-2018年)が短く、長期効果の評価には不十分

- 治療群の定義(総人口基準)は政策の実際の対象(地方版総合戦略の内容・予算規模)と異なる可能性

- 同時期の外生的ショック(2016年熊本地震・2018年西日本豪雨等)の影響が混入している可能性

- 都道府県レベルの分析では、市区町村レベルの政策効果の不均質性を捉えられない

- DiD(差分の差分法)の発想:「政策を受けたグループの変化」から「受けなかったグループの変化」を引くことで、政策以外の時代的な要因(景気・流行など)を相殺して、政策の純粋な効果を取り出せる。

- 「効果なし」も重要な発見:DiD係数がマイナスや非有意になることは、「政策が期待通りでなかった可能性」を示す貴重な情報。統計分析は「意図と違う結果」も誠実に報告するためにある。

- 平行トレンド仮定:DiDの妥当性は「政策がなければ両群は同じトレンドだったはず」という前提に依存する。前提のチェックがどれほど大事かを実例で学べる。

データ・コードをダウンロード

以下のPythonスクリプトを code/ フォルダに、

SSDSE-B-2026.csv を data/raw/ フォルダに置いて実行すると、

全4図と分析結果を再現できます。

使用データ: SSDSE-B-2026.csv(統計センター「社会・人口統計体系データセット」都道府県版)

https://www.nstac.go.jp/use/literacy/ssdse/

pandas numpy matplotlib scipy statsmodels(linearmodels は任意)実行方法:

python3 code/2018_U1_daijin.py