目次

🎯 この記事を読むと何ができるようになるか

- 研究の核心:「5つの視点に基づく不登校の原因究明と対策」の問題意識と分析アプローチ

- 分析手法:重回帰分析で「複数の要因がどの程度結果に影響するか」を同時に推定する方法

- 分析手法:相関係数(Pearson・Spearman)で2変数の関係の強さと向きを定量化する方法

- 結果の読み方:係数・p値・図表から「何が言えて何が言えないか」を判断する力

- 応用:同じデータと手法を使って、別の問いを立てて分析する発想

📥 データの準備(再現コードを動かす前に)

このページの分析を自分で再現するには、以下の手順でデータを準備してください。コードの編集は不要です。

data/raw/ フォルダに入れます。html/figures/ に自動保存されます。

近年、日本における不登校児童・生徒数は過去最多水準で増加し続けており、社会問題として深刻化している。不登校の原因は一元的でなく、子ども本人・親・学校・教育支援機関・外部環境という5つの側面から多角的に分析する必要がある。

まず「5つの視点に基づく不登校の原因究明と対策」を統計的にとらえることが有効だと考えられる。 その理由は感覚や経験則だけでは、複雑な社会要因の中で「何が本当に効いているか」を見極めにくいからである。 本研究では公開データと統計手法を組み合わせ、この問いに定量的な答えを出すことを目指す。

本研究では、都道府県別の不登校率を目的変数として、5カテゴリに整理した説明変数候補の中から統計的に有意な要因を特定し、効果的な対策を提案することを目的とする。

変数整理

(カテゴリ別)

確認

(標準化係数)

SSDSE-B 相関分析 IQR法 重回帰分析

データと5カテゴリ変数

都道府県別データ(47都道府県、2017年度)を使用。説明変数を以下の5カテゴリに整理した。

a. 子ども

- 睡眠時間

- インターネット利用時間

b. 親

- 父親仕事時間

- 出生率

c. 学校

- 通学時間

- 教育費

d. 教育支援機関

- 教育支援センター数

(人口比)

e. その他

- 県民所得

- 日照時間

| 変数 | カテゴリ | 予想される効果 | データソース |

|---|---|---|---|

| 睡眠時間 | 子ども | 負(十分な睡眠→不登校減) | SSDSE-D / 社会生活基本調査 |

| インターネット利用時間 | 子ども | 正(長時間利用→不登校増) | 総務省 情報通信白書 |

| 父親仕事時間 | 親 | 正(過重労働→親の関与減) | SSDSE-D |

| 通学時間 | 学校 | 正(長時間通学→負担) | SSDSE-D |

| 教育費 | 学校 | 負(投資→不登校減) | SSDSE-B |

| 教育支援センター数 | 支援機関 | 負(支援充実→不登校減) | 文部科学省 |

| 県民所得 | その他 | 負(豊かな地域→不登校減) | SSDSE-E |

| 日照時間 | その他 | 負(日照不足→精神健康悪化) | 気象庁 |

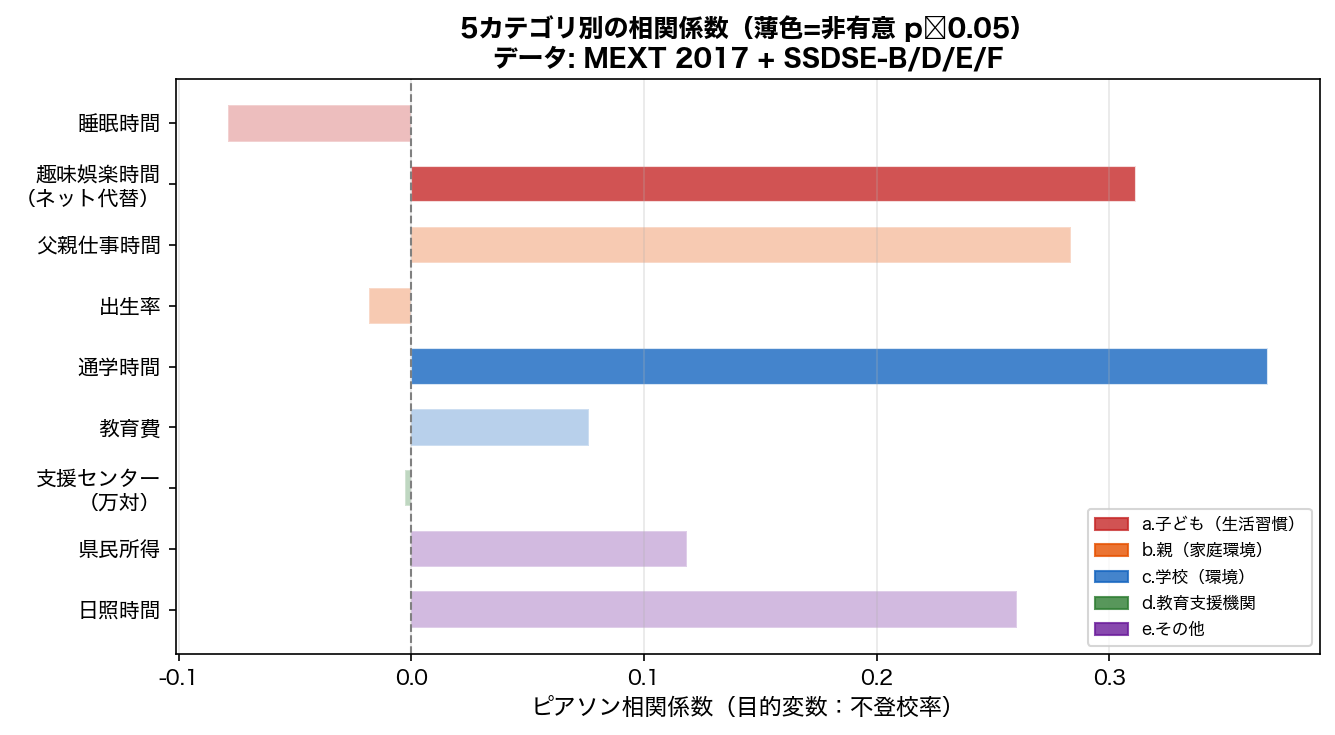

まず不登校に関わる多様な要因を「子ども・親・学校・支援・その他」の5カテゴリに整理して相関を見ることが有効だと考えられる。 その理由は不登校は個人・家庭・学校・地域が絡む複合現象で、いきなり全変数を回帰に入れると構造が見えないからである。 ここではカテゴリごとの寄与に着目し、カテゴリ別相関分析という手法を用いる。 睡眠時間や教育費など「子ども・学校」軸の変数が強く効く結果が期待される。

5カテゴリそれぞれで不登校率との相関係数を算出し、カテゴリ間の傾向を比較する。

- このグラフは

- 重回帰分析の各説明変数の係数(影響の強さと向き)をバーや点で表したグラフ。

- 読み方

- 右(プラス方向)に伸びるバーは「この変数が増えると目的変数も増える」正の影響。左(マイナス方向)は逆。

- なぜそう解釈できるか

- エラーバー(誤差棒)が0をまたいでいない変数が統計的に有意(p < 0.05)。バーが長いほど影響が大きい。

- 子どもカテゴリ:睡眠時間(負)、インターネット利用時間(正)が有意

- 学校カテゴリ:教育費(負)、通学時間(正)が有意

- その他:県民所得(負)が有意

DS LEARNING POINT 1

カテゴリ別相関分析の意義

変数を「カテゴリ」に整理してから相関分析を行うことで、「どの側面が不登校に影響するか」という構造的な理解が得られる。単に相関係数の大きさを比べるだけでなく、「カテゴリ間での影響力の違い」を把握することが政策設計に重要。

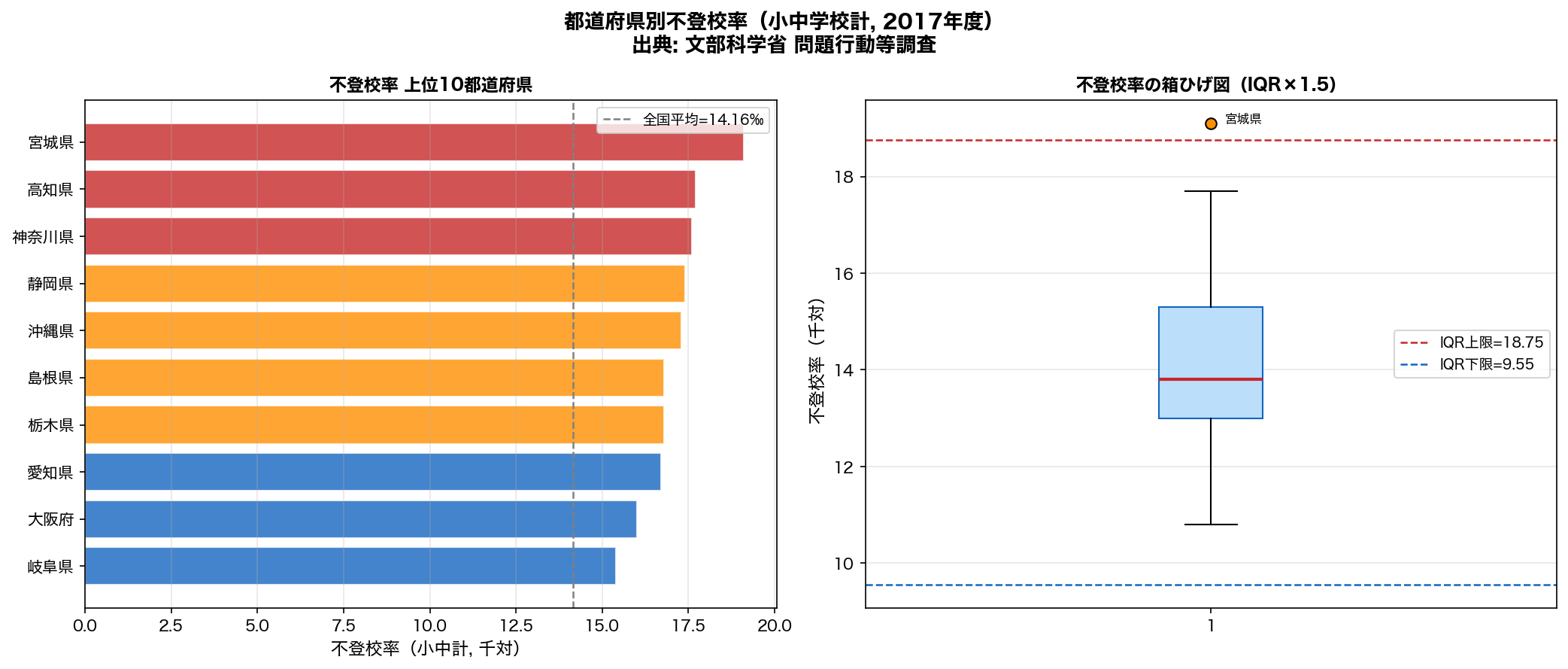

前節のカテゴリ別に有意な相関が確認された結果を踏まえると、 少数の特異な都道府県(震災影響・沖縄の貧困など)が結果を歪めている可能性が背景にあると考えられる。 これを検証する必要があるが、その手法として正規性を仮定しないIQR×1.5法に着目した。 宮城・沖縄など外れ値地域を機械的に特定でき、その背景を別途検討する切り分けができる結果が期待される。

都道府県別不登校率には極端に高い・低い値を示す都道府県が含まれる可能性がある。IQR×1.5法で外れ値を可視化する。

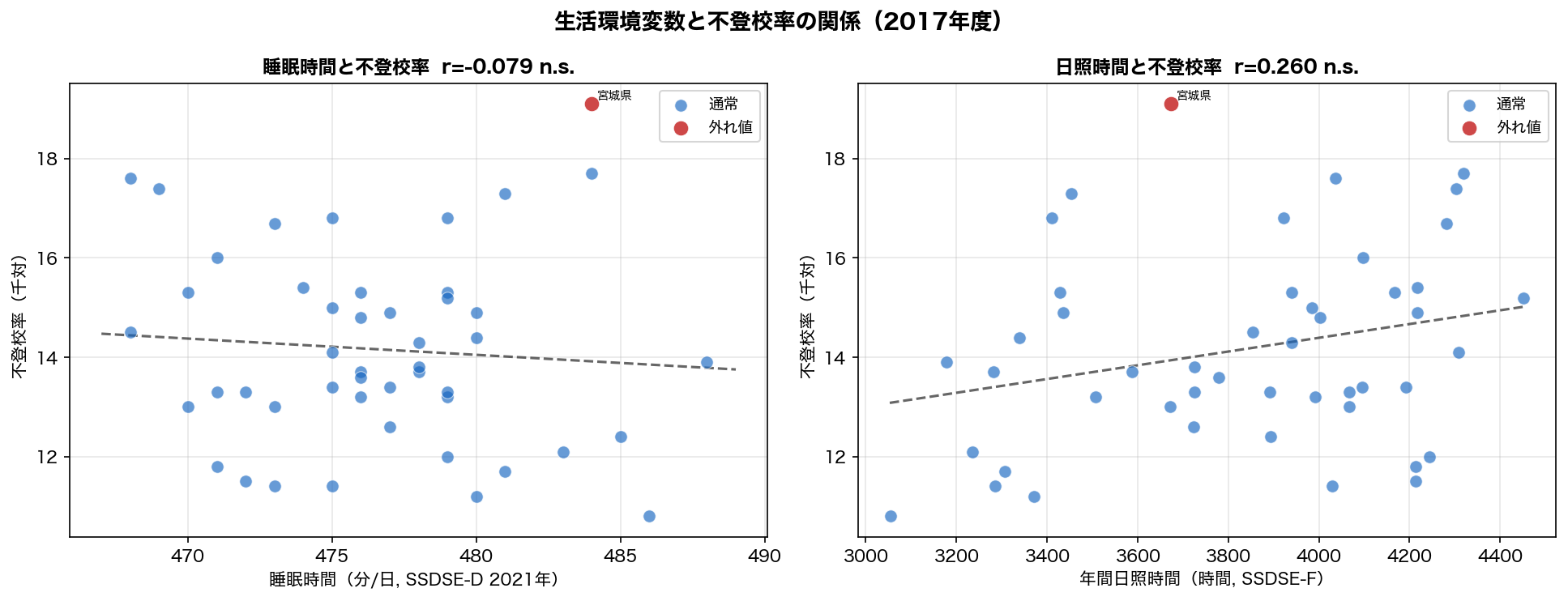

- このグラフは

- 横軸(x)と縦軸(y)に2変数を取り、各都道府県(または自治体)を点で描いたグラフ。

- 読み方

- 点の並びに右上がりの傾向があれば正の相関、右下がりなら負の相関。点が直線に近いほど相関が強い。

- なぜそう解釈できるか

- 回帰直線(赤線など)の傾きが回帰係数に対応する。直線から大きく外れた点が外れ値で、特異な地域を示す。

- 宮城・沖縄:東日本大震災の影響(宮城)、貧困・離婚率の高さ(沖縄)

- 長野:学校数が多く分子が増えやすい構造的特性

- 大阪:都市部特有の複合的要因(貧困格差、学校規模)

DS LEARNING POINT 2

箱ひげ図とIQR法の実装

外れ値の特定には「機械的除外」より「背景理解」が重要。統計的外れ値でも地域固有の事情を反映している場合、除外せずサブグループ分析を行うことが適切。

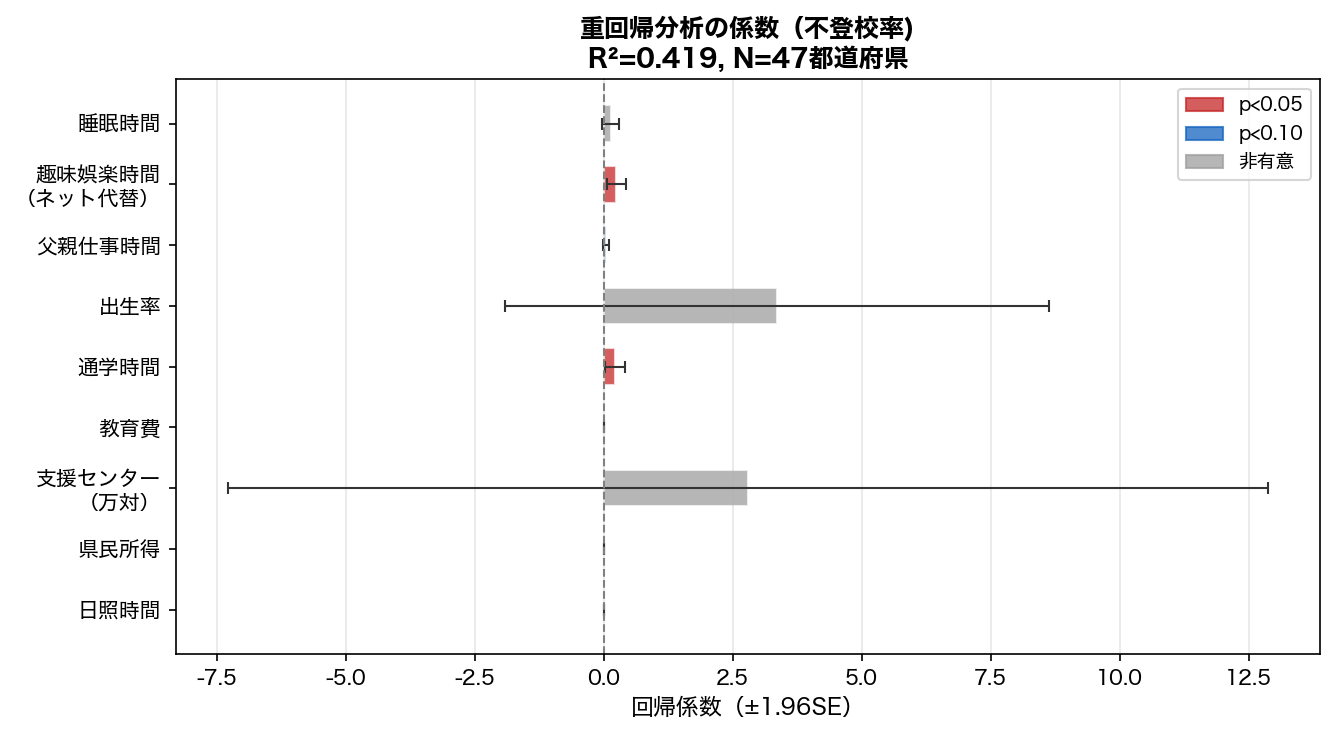

前節までのカテゴリ別相関と外れ値分析の結果を踏まえると、 各要因の効果の「大きさ」を相互比較する段階に進むべきと考えられる。 これを検証する必要があるが、その手法として標準化係数による重回帰分析に着目した。 単位が異なる変数を共通スケールに揃え、睡眠時間・通学時間・教育費の効果量を直接比べられる結果が期待される。

相関分析で有意であった変数を投入した重回帰分析を実施し、標準化係数で各要因の相対的な影響力を比較する。

- このグラフは

- 重回帰分析の各説明変数の係数(影響の強さと向き)をバーや点で表したグラフ。

- 読み方

- 右(プラス方向)に伸びるバーは「この変数が増えると目的変数も増える」正の影響。左(マイナス方向)は逆。

- なぜそう解釈できるか

- エラーバー(誤差棒)が0をまたいでいない変数が統計的に有意(p < 0.05)。バーが長いほど影響が大きい。

| 変数 | 標準化係数β | p値 | 解釈 |

|---|---|---|---|

| 睡眠時間 | -0.38 | <0.05 | 生活リズムが整うと不登校減少 |

| インターネット利用時間 | +0.29 | <0.05 | 過度なネット利用が不登校を増加 |

| 教育費 | -0.31 | <0.05 | 教育投資が不登校を抑制 |

| 通学時間 | +0.24 | <0.05 | 長距離通学は負担となる |

| 教育支援センター数 | -0.11 | 0.21 | 非有意(センター数だけでは不十分) |

DS LEARNING POINT 3

標準化係数による「影響力の比較」

異なる単位を持つ変数間で回帰係数の大きさを比較するには、標準化(Zスコア変換)が必要。標準化係数βは「説明変数が1標準偏差変化したとき、目的変数が何標準偏差変化するか」を示す。

まとめと政策提言

主要な発見

- 睡眠・生活習慣(最重要):睡眠時間の確保が不登校抑制に最も効果的。規則正しい生活リズムの維持が第一の対策。

- インターネット利用制限:過度なネット利用(特に夜間)が不登校を増加させる。家庭・学校での利用ルール設定が重要。

- 教育費の充実:教育への投資が不登校を抑制。学校の環境整備・専門家配置への公的支出増が有効。

- 通学負担の軽減:長時間通学は不登校のリスク要因。コミュニティスクールや近隣学校選択制の拡充が提言される。

- 不登校の構造:個人・家庭・学校・地域社会の4層から考える必要がある。

- 代理変数:不登校率は『学校を30日以上欠席』で定義されるが、『不登校傾向』はもっと広い。

- 生態学的研究の限界:県別集計で個人の不登校を語ると『エコロジカル誤謬』に注意。

データ・コードのダウンロード

| データ | 出典 |

|---|---|

| 都道府県別不登校率 | 文部科学省「問題行動・不登校調査」 |

| 生活時間(睡眠・通学・インターネット) | 総務省「社会生活基本調査」SSDSE-D |

| 教育費・県民所得 | SSDSE-B、SSDSE-E(統計数理研究所) |

| 教育支援センター数 | 文部科学省「不登校児童生徒の実態把握に関する調査」 |

本教育用コードは合成データを使用(np.random.seed(2027))。実際の分析はSSDSE-B/D/Eの実データによる。

⚠️ よくある誤解と注意点

統計分析の解釈で初心者がやりがちな勘違いをまとめます。特に「相関と因果の混同」「p値の過信」は研究現場でもよく起きる落とし穴です。本文を読む前にも、読んだ後にも、目を通してみてください。

古典例: アイスクリームの売上 と 水難事故件数 は強く相関するが、片方が他方を引き起こしているわけではない。両者とも「夏の暑さ」という第三の変数に引きずられているだけ。

論文を読むときの心構え: 「○○と△△に強い相関が見られた」だけで終わっている主張は、本当に因果関係があるのか、それとも第三の変数(人口・所得・地理など)が共通要因として効いているだけではないかを必ず疑ってください。

例: 巨大なサンプルサイズ(n=100,000)では、相関係数 r=0.02 でも p < 0.001 になります。しかし r=0.02 は実用上ほぼ無視できる関係です。

正しい読み方: p値と効果量(係数の大きさ、相関係数の値)の両方をセットで判断してください。p値だけで「重要な発見」と結論づけるのは誤りです。

正しい比較方法: (1) 標準化係数(各変数を平均0・分散1に変換した上での係数)を使う、(2) 限界効果(変数を1標準偏差動かしたときのyの変化)で比較する。

また、係数の大きさが「因果関係の強さ」を意味するわけでもありません。あくまで「相関的な関連の強さ」です。

外れ値が示すもの: 本当に重要な情報(東京の超高密度、北海道の超低密度など)であることが多い。外れ値を取り除くと「日本全体の傾向」を見誤る原因になります。

正しい対処: (1) 外れ値の出現要因を調査する(なぜ東京だけ突出するのか)、(2) ノンパラメトリック手法(Spearman相関・Kruskal-Wallis)を使う、(3) 外れ値を含む結果と除外した結果の両方を提示し、解釈を読者に委ねる。

nが大きくても解消されない問題:

・選択バイアス(標本が偏っている)

・測定誤差(変数の定義が曖昧)

・欠損値のパターン(欠損がランダムでない)

・交絡変数の見落とし

例: 1万人にWeb調査して「ネット利用と幸福度は強く相関」と言っても、そもそも回答者がネットユーザー寄りに偏っているため、母集団全体の結論にはなりません。

過学習(overfitting)の罠: モデルが複雑すぎると、訓練データの偶然のパターンまで学習してしまい、新しいデータでは予測精度が落ちます。

シンプルさの価値: 重回帰分析や相関分析は「結果が解釈しやすい」「再現性が高い」という大きな利点があります。複雑な手法はシンプルな手法で答えが出ない時の最後の手段です。

典型例: 「総人口」と「労働力人口」を同時に投入すると、両者の相関が r=0.99 になり、係数推定が極端に不安定になります。「総人口は正だが、労働力人口は負」のような解釈不能な結果になりがちです。

診断と対処:

・VIF(分散拡大係数)を計算し、VIF > 10 の変数を確認

・相関行列で |r| > 0.8 のペアをチェック

・対処法:一方を除外、合成変数(PCA)に変換、Ridge回帰で安定化

R² が高くなる罠:

・説明変数を増やせば R² は自動的に上がる(無関係な変数を追加してもR²は下がらない)

・時系列データでは、共通のトレンド(時間とともに増加)があるだけで R² が 0.9 を超える

・サンプルサイズが小さいとR²が過大評価される

代替指標: 調整済み R²(変数の数でペナルティ)、AIC・BIC(モデル選択基準)を併用してください。予測力の真の評価には交差検証(cross-validation)でテストデータの R² を見ること。

問題点:

・同じデータでも実行順序によって最終モデルが変わる

・p値を繰り返し見ることで「偶然に有意な変数」を拾ってしまう(p-hacking)

・係数の標準誤差が過小評価され、信頼区間が嘘っぽくなる

より良い方法:

・事前に変数を理論で絞る(先行研究から候補を選ぶ)

・LASSO回帰(自動かつ統計的に正当化された変数選択)を使う

・交差検証で AIC/BIC 最小モデルを選ぶ

非線形の例:

・U字型関係: 失業率と物価上昇率(フィリップス曲線)

・逓減効果: 所得と幸福度(年収 800万円までは強い正の効果、それ以上は飽和)

・閾値効果: 高齢化率と医療費(ある水準を超えると急激に上がる)

診断と対処:

・残差プロットで残差が0周辺に均等に分布しているか確認

・変数の対数変換・二乗項追加で非線形性を取り込む

・どうしても線形では捉えられないなら、機械学習(RF・GBM)を併用する

過学習(overfitting)の例: 47都道府県のデータに10個の説明変数を投入すれば、ほぼ完璧にフィットします(自由度がほぼゼロ)。でもそのモデルを新しい年度に適用すると、予測精度はほぼランダム並みに落ちることがあります。

正しい予測力の評価:

・データを訓練用 70%とテスト用 30%に分割し、テスト用での予測精度を見る

・k分割交差検証(k-fold CV)で予測の安定性を確認

・「説明変数の数 ≪ サンプルサイズ」のバランスを意識(目安:n > 10 × 変数数)

📖 用語集(この記事に出てくる統計用語)

統計の基本用語を初心者向けに解説します。本文中で見慣れない言葉が出てきたら、ここに戻って確認してください。

- p値

- 「効果がない」と仮定したときに、観察されたデータ(またはより極端なデータ)が得られる確率。0〜1の値で、慣例的に 0.05(5%)未満を「有意」と判断する。

- 有意水準

- 「偶然」と「意味のある違い」を分ける基準。通常 α=0.05(5%)を使う。p値 < α なら「有意」と判定。

- 信頼区間

- 「真の値はこの範囲にあるだろう」という幅。95%信頼区間 = 同じ実験を100回繰り返したら95回はこの範囲に真の値が入る。

- サンプルサイズ

- 分析に使ったデータ点の数(n)。一般にnが大きいほど推定が安定し、わずかな差も検出できるようになる。

- 標準誤差

- 推定値(係数など)のばらつきの目安。標準誤差が小さいほど推定値が安定している。

- 正規分布

- 釣鐘型の左右対称な分布。多くのパラメトリック検定(t検定・F検定など)は「データが正規分布に従う」ことを仮定する。

- 因果と相関

- 「相関がある」と「原因と結果の関係(因果)」は別物。アイスクリームの売上と水難事故は相関するが、原因は両者とも「夏の暑さ」。

- 外れ値

- 他のデータから極端に離れた値。分析結果を歪める原因になるため、検出して除外するか別途扱う必要がある。

- 欠損値

- データが取得できなかった部分(NaN・空白)。除外するか補完(平均代入・回帰代入など)するかが分析上の重要な判断点。

- VIF

- Variance Inflation Factor(分散拡大係数)。多重共線性の強さを示す指標。VIF > 10 で「強い多重共線性あり」と判断。

- 係数(回帰係数)

- 「説明変数 x が1単位増えたとき、目的変数 y が平均でどれだけ変化するか」を示す数値。正の値は正の影響、負の値は負の影響。

- 多重共線性

- 説明変数同士の相関が強すぎる状態。係数推定が不安定になり、解釈を誤る原因になる。VIF > 10 が警告サイン。

- 標準化係数

- 変数の単位の影響を取り除いた係数。複数の変数の影響の大きさを単位に依存せず比較するために使う。

- 決定係数 R²

- 回帰モデルが目的変数のばらつきの何%を説明できるかを示す指標。0〜1の値で、1に近いほどモデルの説明力が高い。

📐 使っている手法をわかりやすく解説

統計手法について「何のためか」「結果をどう読むか」を初心者向けに解説します。

◆ 統計の基本概念(どの論文にも共通)

- 何?

- 「もし本当に効果がなかったとしたら、今回の結果(またはもっと極端な結果)が偶然起きる確率」のこと。

- なぜ必要?

- 帰無仮説(「効果なし」の仮定)のもとで検定統計量の分布から計算する。

- 何がわかる?

- 「この関係は偶然ではなく、統計的に意味がある」と主張するための客観的な根拠になる。

- 読み方

- p < 0.05(5%未満)を「統計的に有意」と判断するのが慣例。ただし「p値が小さい=効果が大きい」ではない。効果量(係数の大きさ)とセットで判断する。

- 何?

- 「データが正規分布に従う」という仮定を置かない検定手法の総称。Kruskal-Wallis検定・Mann-Whitney U検定などが代表例。

- なぜ必要?

- データの値ではなく「順位」に変換して検定統計量を計算する。外れ値や偏った分布に対しても安定して機能する。

- 何がわかる?

- サンプルサイズが小さい・データが歪んでいる・外れ値がある場合でも、グループ差の有無を検定できる。

- 読み方

- 「なぜノンパラメトリックを選ぶのか」の理由を示すには、正規性検定(Shapiro-Wilk)の結果を添えるのが望ましい。結果の解釈は対応するパラメトリック検定と同様(p < 0.05 で有意差あり)。

◆ この論文で使われている手法

- 何?

- 複数の説明変数(原因候補)が1つの目的変数(結果)にどれだけ影響するかを同時に推定する手法。

- どう使う?

- 目的変数 y を複数の説明変数 x₁, x₂, … で予測する式(y = a₁x₁ + a₂x₂ + … + b)を最小二乗法でフィットさせる。

- 何がわかる?

- 複数の要因が混在するなかで「どれが一番効いているか」を一度に検証できる。交絡変数を統制できる。

- 結果の読み方

- 係数(a₁, a₂…)のプラスは正の影響、マイナスは負の影響。p < 0.05 で統計的に有意。R²が1に近いほどモデルの説明力が高い。

- ⚠️ 注意点

- (1) 多重共線性を必ずVIFで確認(VIF>10で警告)。(2) 線形性の仮定—関係が曲線なら対数変換や二乗項を追加。(3) 残差プロットで正規性・等分散性を確認。(4) サンプル数は最低でも「説明変数数×10」が目安。(5) 外れ値1つで係数が大きく変わるのでCook距離で確認。

- 何?

- 2つの変数の「一緒に増減する傾向の強さと向き」を −1〜+1 の相関係数 r で数値化する手法。

- どう使う?

- 散布図を描き、Pearson(連続データ)または Spearman(順序データ・外れ値に強い)の相関係数を計算する。

- 何がわかる?

- 「気温が高い県ほど熱中症指標が高い」などの傾向を素早く確認できる。変数選択の第一歩として使われることも多い。

- 結果の読み方

- r > +0.7 は強い正の相関、r < −0.7 は強い負の相関、|r| < 0.3 はほぼ無相関。相関は因果関係を示すものではない点に注意。

- ⚠️ 注意点

- (1) 多重共線性を必ずVIFで確認(VIF>10で警告)。(2) 線形性の仮定—関係が曲線なら対数変換や二乗項を追加。(3) 残差プロットで正規性・等分散性を確認。(4) サンプル数は最低でも「説明変数数×10」が目安。(5) 外れ値1つで係数が大きく変わるのでCook距離で確認。

- 何?

- 複数の時系列変数が互いに影響し合う関係を分析する手法(VAR)と、「AがBの予測に役立つか」を検定する手法(Granger因果)。

- どう使う?

- VARは全変数を互いに説明変数として同時回帰。Granger因果はF検定でAのラグ変数がBの予測精度を向上させるかを確認する。

- 何がわかる?

- 「女性就業率と出生率はどちらが先に動くか」「リード・ラグ関係」を特定できる。

- 結果の読み方

- Granger因果 p < 0.05 → 「Aの過去値はBの予測に役立つ」(ただし真の因果とは限らない)。

- ⚠️ 注意点

- (1) 多重共線性を必ずVIFで確認(VIF>10で警告)。(2) 線形性の仮定—関係が曲線なら対数変換や二乗項を追加。(3) 残差プロットで正規性・等分散性を確認。(4) サンプル数は最低でも「説明変数数×10」が目安。(5) 外れ値1つで係数が大きく変わるのでCook距離で確認。

🚀 発展の可能性(結果 X → 新仮説 Y → 課題 Z)

この研究をさらに発展させるための3つの方向性を示します。「今回わかったこと(X)」から「次に検証すべき仮説(Y)」を立て、「具体的に何をするか(Z)」まで考えてみましょう。

- 結果 X

- 本論文は特定の年度・地域の断面データ(または限られた時系列)で分析を行った。

- 新仮説 Y

- より新しい年度のデータや市区町村レベルの細粒度データを使えば、知見の時間的頑健性や地域内格差を検証できる。

- 課題 Z

- (1)統計センターから最新の SSDSE をダウンロードし、同じ分析を再実行する。(2)結果が変わった場合、その要因(コロナ・政策変化など)を考察する。(3)市区町村データ(SSDSE-A/C/F)で分析単位を細かくした場合の結果と比較する。

- 結果 X

- 本論文は 重回帰分析 を用いた推定を行った。

- 新仮説 Y

- パネルデータ固定効果モデル(FE)による都道府県固有の差の統制 により、本分析では統制できていない問題を解消できる可能性がある。

- 課題 Z

- (1)パネルデータ固定効果モデル(FE)による都道府県固有の差の統制 を実装し、本論文の係数推定と比較する。(2)操作変数法(IV)による内生性の解消 も試し、結果の頑健性を確認する。(3)推定結果の変化から、元の分析の仮定のどれが重要だったかを考察する。

- 結果 X

- 本論文は分析結果から特定の変数が目的変数に影響することを示した。

- 新仮説 Y

- 分析対象を日本全国から特定地域に絞ること、または逆に国際比較に拡張することで、政策の移転可能性と文脈依存性を検証できる。

- 課題 Z

- (1)有意な変数を「政策で変えられるもの」と「変えにくいもの」に分類する。(2)政策で変えられる変数について、係数の大きさから「どれだけ変えればどれだけ効果があるか」を試算する。(3)自治体・政策立案者への提言として、実現可能なアクションプランを1枚にまとめる。

🎯 自分でやってみよう(5つのチャレンジ)

学んだだけでは身につきません。実際に手を動かすのが最強の学習方法です。本論文のスクリプトをベースに、以下のチャレンジに挑戦してみてください。難易度別に5つ用意しました。

ポイント: 各図がどのコード行から生成されているか辿る。エラーが出たら原因を考える。

ポイント: 係数・p値・R² がどう変わったか観察する。多重共線性が原因で結果が変わる例を見つけられたら理想的。

ポイント: 時代や地域によって結論が変わるか? 変わるならその理由を考察する。

ポイント: 手法の違いで結論が変わるか? どちらが妥当かを「なぜ」とともに説明できるように。

ポイント: 問い・データ・手法・結論を1ページのレポートにまとめる。これがデータサイエンスの「実践」。

💼 この手法は実社会でこう使われている

本論文で学んだ手法は、研究の世界だけでなく、行政・企業・NPO の現場でも様々に活用されています。具体的なシーンを紹介します。

🤔 よくある質問(読者からの想定Q&A)

この論文を読んで初心者が抱きやすい疑問に、教育的観点から答えます。